IBM Sustainability Software

医療分野へのAIの活用事例 | 日本眼科AI学会主催ウェビナーレポート#3

2022年06月03日

記事をシェアする:

日本眼科AI学会が主催する3回シリーズ「オンライン教育セミナー これであなたもAIが怖くない」の最終回となる「第3回 日常にAIを活用するための基礎知識を学ぼう」が2021年11月18日開催されました。

眼科におけるAI活用を考える上で最も重要とも言える倫理やガイドラインに関する視点を中心に、眼科・医療の専門家や法律、先進テクノロジーの研究者が意見を交わした様子をお届けします。

- 第1回のレポートはこちら | https://www.ibm.com/blogs/solutions/jp-ja/iot-opthalmology1

- 第2回のレポートはこちら | https://www.ibm.com/blogs/solutions/jp-ja/iot-opthalmology2

AI活用のためのガイドライン、倫理などの理解 | 個人情報保護などの課題と法律、AI倫理

渥美坂井法律事務所・外国法共同事業 パートナー弁護士の落合孝文氏は、医療、IT、金融などの複数業界に深い知見を持つ専門家であり、内閣府や厚生省、総務省などの政府/公的機関の多くの検討会で委員を務めると同時に、複数の業界団体でも理事や委員を務めている。

そんな落合氏の講演の一部を紹介する。

ヘルスケアとデータサイエンスにおける個人情報保護などの課題

個人情報保護に関連する法令には、行政機関保有個人情報保護法、独立行政法人保有個人情報保護法などの一般にもよく知られているものに加え、地方公共団体ごとに制定している条例などが多数あり、合計すると2000個近くにのぼる。それぞれの「個人情報」の定義や解釈の差異が情報利活用や連携を阻んでおり、この問題は「個人情報保護法制2000個問題」としても知られている。

情報共有に支障を生じさせているこの状況に対し、今後2年間で対象の捉え方などに見直し・整備が入り状況は改善されていく見込みだが、医療・健康産業における研究開発においては、情報利活用にあたり「ガバナンス整備のための実体ルール整備」の検討も併せて重要となる。

たとえば、同意に関するガバナンスを考慮しても、「オプトイン・オプトアウト、黙示の同意など、現在提供されている方法で十分な権利保護ができているのか?」、「個人のデータコントローラビリティが低下する恐れはないか?」などの問題が考えられる。

また、PHR(パーソナルヘルスレコード)や情報銀行(情報信託スキーム)についての同意の取り扱いも、それぞれ検討を進めていく必要がある。

いずれにしても、現在はワーキンググループなどにより、「最低限、本人経由でデータを引き継げるように」と、信頼性の高い業者の認定やマイナポータルとのAPI経由での接続要件などが議論されている。

AI活用時に考慮すべき法律

AIを利用する際には、医師法、薬機法等の法令との関係に留意を行うことが必要である。法規制を考える上では、まずは以下の「医療機器」の定義からしっかりと見ていく必要がある:

医療機器とは? — [ヒト/動物の] + [疾病の診断/治療/予防に使用されること 又は 身体の構造/機能に影響を及ぼすこと] + [を目的とした機械器具等(プログラムを含む)]

機器は、人体に与えるリスクや機能・構造の程度により4段階にクラス分けされる:

-

- Class1 | 一般医療機器

- Class2 | 管理医療機器

- Class3 | 指定高度管理医療機器

- Class4 | 高度管理医療機器

承認・認証のプロセスなどが異なるので、機器やプログラムの開発時にはしっかりした検討が必要である。また同時に、認証する側においては、承認・認証が開発側のアップデートや改善の足枷にならないようにすることが重要だ。

考慮すべきAI倫理

AIと倫理に関する議論も高まっている。落合氏は総務省AIネットワーク社会推進会議 AIガバナンス分科委員として数年間検討に参画しており、その経験を踏まえてAI利活用における留意点などを解説した。

.png) 総務省 AI利活用ガイドライン(出典: 総務省AIネットワーク社会推進会議 報告書2019)より

総務省 AI利活用ガイドライン(出典: 総務省AIネットワーク社会推進会議 報告書2019)より

上の図でサービスプロバイダや利用者として書かれている関係者に向け、総務省が提示しているAI利活用の10原則が以下となっている。

1〜3が「主に便益の増進」を、7〜10が「信頼の醸成」を、そして1〜10のすべてが 「リスクの抑制」に関したものとなっている。

- 適正利用の原則

- 適正学習の原則

- 連携の原則

- 安全の原則

- セキュリティの原則

- プライバシーの原則

- 尊厳・自律の原則

- 公平性の原則

- 透明性の原則

- アカウンタビリティの原則

AI関連のサービスには、実際に利用することで表出化してくる問題が含まれていることも多い。

実行後の改善が重要であるというのは、医療機器にも倫理にも通ずるものである。

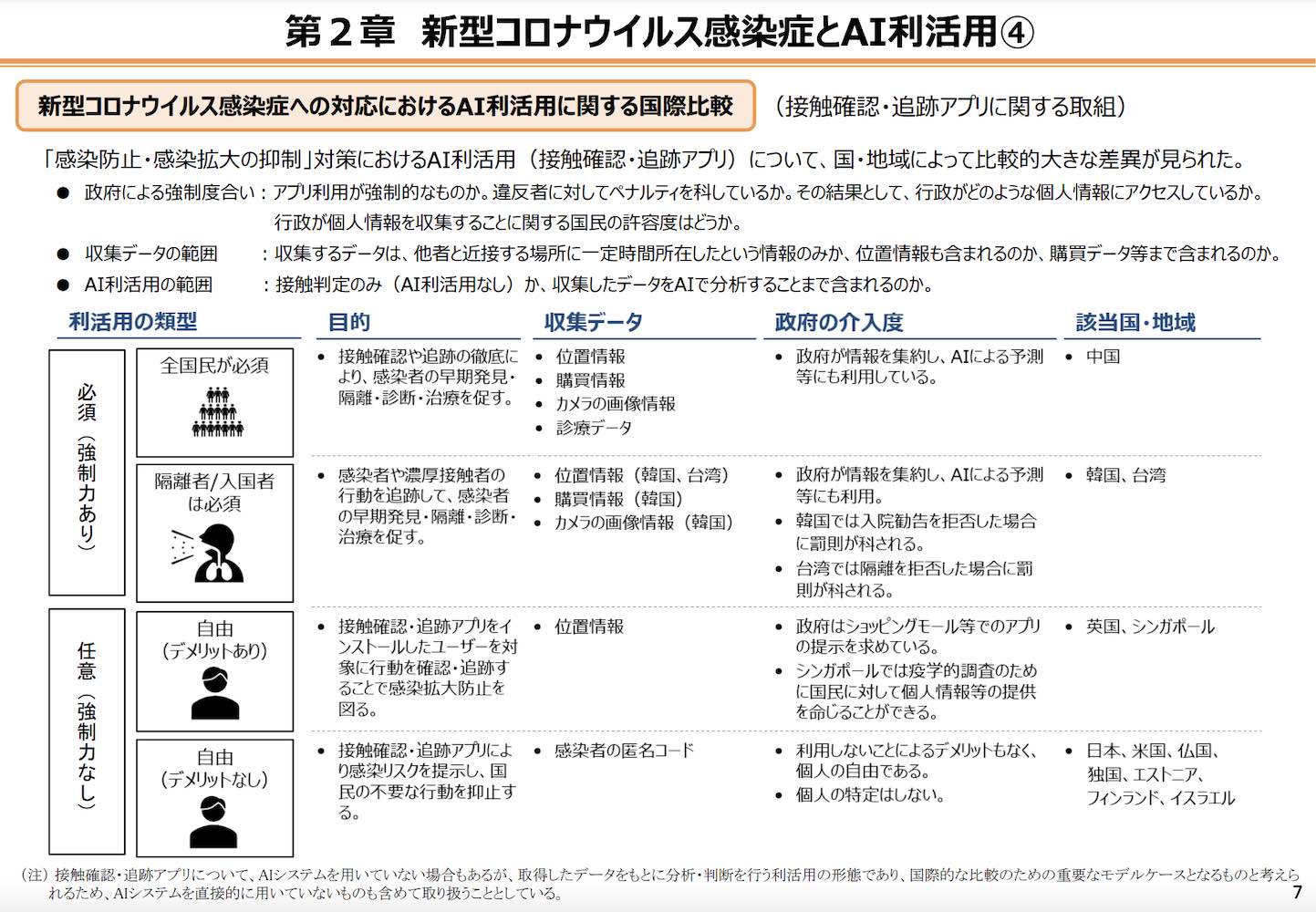

落合氏が最後に紹介したのが、新型コロナウイルス対応におけるAI利活用の国際比較だ。以下の図と併せて、落合氏が語った言葉を紹介する。

「感染防止・感染拡大の抑制を目的とした接触確認・追跡アプリに関する各国の取り組みを比較することで、その背景となっている社会や文化、そしてそれを成立させる各国の倫理が見えてきます。倫理には万国共通なものもありますが、相対的な要素もあるのです。」

新型コロナウイルス感染症とAI利活用(出典: 総務省AIネットワーク社会推進会議 報告書2021概要)より

眼科学会AIガイドライン

続いて登壇したのは、京都大学医学部附属病院 眼科特定講師であり、行政の立場でも厚生労働省などから先進医療に関わってきた三宅正裕氏だ。

三宅氏は冒頭、人工知能に関するここ数年の動きを総括し、AIが現実的に活用されるフェーズへと入ったことを、そしてこれからの日本社会においては「社会実装の仕組みを整備すること」が重要であるということを強調し、AI社会実装の主な課題が以下4点にあると説明した。

- データがあれば解決すると分かっていても、データが入手できない

- AIで解決できることは分かっていても、規制のため実現できない

- 完成したAIが流通すれば解決できることは分かっていても、マネタイズできないので流通させられない

- 精度○○%のAIができたけれど、実臨床で十分な性能なのかが分からない

この4つの課題の解決アプローチの1つが、AMED (国立研究開発法人日本医療研究開発機構)が2016年から行なっていた画像関連データベースのプラットフォームを日本眼科学会が引き継ぐ形で設立された、「JOI registry(Japan Ocular Imaging Registry)」だ。

JOI registryの、眼科関連施設をネットワーク化してそのハブとなるという働きにより、データ入手とAIのマネタイズという上記1と3の問題が解決される。

そして医療機器の該当性判断と、該当する場合の臨床的位置付けを明確化・精緻化するガイドラインにより、上記2と4の問題を解決する。

三宅氏は最後に、日本眼科AI学会における「緑内障を診断するAI」を例に、臨床的位置付けを「陽性的中率」「隠性的中率」「想定有病率」の関係を用いて説明した。

ここでは詳細は省くが、数値的な計算により、「どの程度の的中率であれば許容できるのか」、「その的中率を達成するには、事前確率もしくはAIの精度をどの程度にコントロールすれば良いのか」について調査し、報告書にまとめた取り組みが紹介された。

AI技術の抱える課題や社会的な活用に向けて考慮すべき点

ここからは、シリーズ全3回の講演者による「AI技術関連の課題」や「社会実装における考慮点」、そして「AIは味方それとも敵?」という観点での公開討論が行われた。ファシリテーターを務めたのは、オーガナイザーである山梨大の柏木賢治教授だ。

以下、印象的だった言葉をいくつかピックアップしてお伝えする。

落合孝文(渥美坂井法律事務所・外国法共同事業 パートナー弁護士)

- 行政との対応・製品化についてだが、薬事など、日本においては保険をはじめとした多数の制度があり、諸外国のスピードについていくのは難しいのが実情。とはいえ、日本も改善は進んでいる。

- 「リーガルテック」という言葉も広がっているように、医療界と同様、あるいはそれ以上にAIの進歩は弁護士界に影響を与えている。すでに、以前よりもより専門性の高い依頼が増えてきており、今後はコンサルタント的な役割が増えるのではないだろうか。そして弁士の大半は、こうした流れを脅威とは捉えていないと思う(ただし、それは単に「警戒感の欠失」に過ぎないのかもしれないが)。

三宅正裕(京都大)

- AI技術の実装に対する社会的コンセンサスだが、従来の漠然とした不安や「AI対人間」という図式の思い込みは解けてきているのではないかと思う。

- 現在は「AIを使いこなせる人」と「そうではない人」の差が表出化してきている段階。日本はこの点で遅れているかもしれない。今後はAIを「他人事」と考えず、それがもたらすメリットとデメリットについて各個人が考えると同時に、AIの基本的な知識を身につけることが必要であろう。

田淵 仁志(広島大/ツカザキ病院)

- 「AIを何にどう使っていくか」という議論は、もう少し広く行う方が良いのではないかと思っている。医療現場からは、企業や行政が急ぎ過ぎているようにも見えていて、それが「すでに高い費用対効果を出している日本の医療から、さらに医療費を削ろうとしているのではないのか?」という不安や疑問を引き起こしているようにも思える。

- AIというかディープラーニングについてだが、医師とエンジニアが協力していくことが欠かせないだろう。

- 「電子カルテの標準化」はもう何年も言われていることなのに、なぜ未だに成功しないのか。

加藤 憲(日本眼科医療機器協会)

- AI推進に向けての体制づくりについてだが、やはり「薬事の壁」が課題になっている。現状は、モノはすでにほぼできているけれど、市場に広まらないというのが実情だと認識している。

- メタボリックシンドロームに着目した特定健診から、いかに眼科診察が必要な患者を見つけられるかが重要である。とりわけ、失明原因の上位にあがる緑内障の患者を見つけられるかが重要。そして受診患者が増えたときに、誰がどうやって画像診断をするのかと言えば、やはりそれはAI活用ではなかろうか。

先崎心智(日本IBM ヘルスケア&ライフサイエンス)

- 三宅先生も言われていた通り、「AI対人間」という図式は終わっていると思う。そもそもIBMは、AIのAを「Artificial(人口)」ではなく「Augmented(拡張)」としている。つまり厳密には「人工知能」ではなく「拡張知能」であるという認識であり、AIは人間を支援するもの。

- AI推進の妨げとしては、どのような根拠から判断したのかが説明できないという「ブラックボックス化」も大きいと思っている。IBMは信頼性と透明性を担保する「説明可能なAI」の開発を進めている。信頼性と透明性の担保が納得感を与え、それにより心的バリアも下がってきていることを感じている。

吉田彰(共同オーガナイザー)

- AIの実装に対する社会的コンセンサスについてだが、「AIを道具として使っていこう」という流れはもうできているのではないか。そこで課題となるのが、道具の使い方をどう学ぶかという問題である。使う側も、道具と一緒に「進化」していくことが肝要。

- これからは「個人」としてAIを使うだけではなく、「チーム」としてAIという道具を何にどう活用していくのかが問われる。「集合知としての道具の活かし方」を考え、探っていけるチームこそが、「強いチーム」となっていくであろう。

討論を受け、オーガナイザーである柏木教授は全3回の「オンライン教育セミナー これであなたもAIが怖くない」を以下の言葉で締め括った。

「『人類の歴史とは道具の歴史』と言われることもあります。また、『人は火を使うことでより人になった』という言葉もあります。私たち日本眼科AI学会も、それを踏まえて今後も活動を続けていく必要があることを感じています。」

今後も、日本眼科AI学会の取り組みに注目していきたい。

問い合わせ情報

関連記事

TEXT 八木橋パチ

法務・AIリスクのスペシャリスト三保友賀が語る「ダイバーシティ」 | インサイド・PwDA+7(前編)

Data Science and AI, IBM Sustainability Software

日本IBMにて法務、特にAI倫理・リスクのスペシャリストとして、そして同時にLGBTQ+コミュニティー*1やPwDAコミュニティー*2のアライとして積極的に活動している三保友賀さんにお話を伺いました。 <もくじ> 企業内 ...続きを読む

持続可能な未来にエネルギーを | 再エネの実例と使用例

IBM Sustainability Software

化石燃料からの移行を進めるために、再生可能エネルギーを求める国や企業、個人が増え続けています。 太陽光や風力などの再生可能エネルギーによる世界の発電能力は、2023年には50%増加しました。 そしてドバイで開催された国連 ...続きを読む

スコープ3排出量計算とレポートを自動化&強化 | IBM Envizi Supply Chain Intelligence

Client Engineering, IBM Sustainability Software

IBM Enviziは、ESGデータ収集・分析・報告プラットフォームであるIBM Envizi ESG Suiteに、スコープ3の排出量計算とレポーティングを一層強化する新モジュール「Envizi Supply Chai ...続きを読む