Data Science and AI

謎に包まれていた脳の星状膠細胞にAIのトランスフォーマーが光を当てる

2023年09月12日

カテゴリー Data Science and AI

記事をシェアする:

研究者たちは、AIのトランスフォーマーが情報を処理する方法と、神経細胞や星状膠細胞のネットワークが情報を処理する方法の類似点を探っています。

星状膠細胞(アストロサイト、せいじょうこうさいぼう)は脳内で最も多く存在する細胞のひとつです。しかし、星状膠細胞よりも神経細胞(ニューロン)の方が注目されがちな傾向にあります。その理由のひとつは、神経細胞と星状膠細胞が無言でやりとりする化学信号よりも、神経細胞の電気信号の方が測定しやすいからでした。

脳神経細胞に織り込まれたこの星形の細胞がより鮮明に見えるようになったことで、その状況は変わりつつあります。新しいカルシウム・イメージング技術によって、科学者たちは隣接する神経細胞を星状膠細胞が活性化させたり抑制したりするために使う信号を可視化して研究することができるようになりました。そして今、ChatGPTやBardのような生成AIチャットボットを支える強力なアーキテクチャーであるトランスフォーマーが、星状膠細胞が計算に関して何をしているのかについての新たな洞察を提供しています。

Proceedings of the National Academy of Sciences(PNAS)に掲載された新しい研究で、IBM、ハーバード大学、マサチューセッツ工科大学(MIT)の研究者たちは、星状膠細胞と神経細胞のネットワークがどのように情報を処理し、脳の学習と記憶に寄与するかを探るために、トランスフォーマーを使用しました。彼らのモデルは、言語や画像を処理する際に、神経細胞と星状膠細胞がどのようにコミュニケーションするかを理論的に示した初めてのものです。

IBM ResearchのAI研究者 Dmitry Krotovは言います。「脳の神経細胞は、現代のAIにおける人工ニューラルネットワークにインスピレーションを与えるのに役立ちました」「私たちは逆に最近のAIの進歩が神経細胞や星状膠細胞の生物学的計算について何を教えてくれるかを見てみたかったのです」

トランスフォーマーはもともと言語を扱うために設計されましたが、現在では画像、音声、音一般の処理に広く使われています。トランスフォーマーが登場する前は、ニューラルネットワークは、収集・整備にコストのかかるラベル付きデータセットで学習する必要がありました。トランスフォーマーは、膨大な生のデータセットを取り込み、その根底にある構造を抽出することができるため、このボトルネックを解消しました。大規模データの圧縮された表現を作成することで、基盤モデルとして知られるトランスフォーマー・ベースのAIモデルをファイン・チューニングして、さまざまなタスクに適用できるようになりました。

トランスフォーマー以前、言語モデルを学習するための最も一般的なAIアーキテクチャーは、リカレント・ニューラル・ネットワーク(RNN)でした。RNNは、文中の各単語を先行する単語によって決定される隠れ状態と比較します。これとは対照的に、トランスフォーマーには「アテンション」メカニズム(注意機構)があり、長い文脈ウィンドウを持っています。トランスフォーマーは、より多くの単語をメモリーに保持することで、文中のすべての単語を一度に比較することができ、単語が互いにどのように関連しているかについてのより豊かな表現を構築することができます。このことが、モデルの学習にラベルつきデータを不要とすることにつながっています。

トランスフォーマーの生物学的アナロジー

トランスフォーマーは2017年の登場以来、機械学習のパラダイムシフトをもたらしました。タスクごとにAIモデルを訓練する代わりに、トランスフォーマーを使えば、追加のチューニングによって同じモデルを何度も繰り返しリサイクルすることができます。トランスフォーマーはAIを飛躍的に身近なものにし、企業規模でAIをチューニング/展開できる新しいIBMのエンタープライズ・プラットフォームwatsonxのようなブレークスルーに繋がりました。

言葉のためのRNNや画像のための畳み込みニューラルネットワーク(CNN)と同じように、トランスフォーマーは人工的な「ニューロン(神経細胞)」のネットワークで構成されています。KrotovはIBMで、ニューラルネットワークを連想記憶のデジタルなアナロジーとして探求することに長い間興味を持っていました。連想記憶とは、顔と名前を対応づけたり、イチゴを見たときに匂いを思い出したりする能力のことです。

トランスフォーマーの論文が登場したときにそれはKrotovの興味を引きましたが、それは単に “Attention Is All You Need “というキャッチーなタイトルに惹かれたからだけではありませんでした。彼はそれまで何年もの間、ニューラルネットワークの記憶容量を増やす研究に取り組んでいました。2021年の論文で、彼はプリンストン大学の神経科学者John Hopfieldとともに、トランスフォーマーにおける注意機構と、生物学の神経細胞における連想記憶が、計算に関して類似していることを示しました。しかし、生物学の神経細胞がAIトランスフォーマーの記憶容量に匹敵するためには、3つ以上のニューロンが1つのシナプスで接続されていなければならないという仮説を立てました。しかし自然界では、シナプスでつながるニューロンは2つだけです。

トランスフォーマーがAIにおけるデフォルトのアーキテクチャーになりつつある中、星状膠細胞に注目してつけられる星印もまた増えてきました。何年もの間、星状膠細胞は神経細胞をサポートする細胞であって、血流を調整し、過剰な神経伝達物質を除去するのが役割と見なされてきました。しかし、カルシウム・イメージング研究によって、星状膠細胞が情報処理においても重要であることが次第に明らかになってきました。

Leo KozachkovはMITの博士課程に在籍していたとき、星状膠細胞が神経細胞とコミュニケーションしその振る舞いに影響を与えるのに十分な速さでカルシウム信号を送ることができることを確認した最初の論文を読みました。彼は2022年、MIT-IBM Watson AI Labにインターンとして加わりました。そして彼とKrotovは、星状膠細胞が記憶に関与しているかどうかを探ることにしました。

星状膠細胞と神経細胞で生物学的に実現されたトランスフォーマー

神経細胞は、神経伝達物質と呼ばれる化学物質を小さなシナプス間隙に送り込むことで、互いにコミュニケーションをとっています。1つの星状膠細胞には何百万もの突起があり、そのそれぞれがシナプス間隙に巻きついていて、そこで神経伝達物質のレベルを感知し神経伝達物質を取り込んだり放出したりすることで、神経細胞のメッセージを消したり増幅したりします。

何百万ものシナプスからの信号を一度に集めることで、星状膠細胞は一種のメモリー・バッファーの役割を果たし、近傍の神経細胞から受け取った情報を保存・統合しているのかもしれない、とKrotovは言います。この仕組みのモデルを構築するために、KrotovとKozachkovは、トランスフォーマーの基礎となる数学的理論を神経細胞・星状膠細胞モデルに適用しました。ハーバード大学の共著者Ksenia Kastanenkaをはじめとする神経科学者の意見を取り入れながら、何度も試行錯誤を繰り返した結果、彼らは神経細胞・星状膠細胞ネットワークがどのようにメモリーに「読み書き」するのかを説明する理論モデルにたどり着きました。

仮説を検証するため、彼らはPNASの論文の要旨をそのモデルに与え、モデルが各単語を処理する際の星状膠細胞の反応だけを取り出し、そのカルシウム・レベルの変動を計算しました。そして彼らは同じことを事前学習済みトランスフォーマーに対しても行い、各単語を処理する際のアテンションの変動を記録し、他の単語に対する相対的な重要度を計算しました。

両者の反応を比較したところ、星状膠細胞のモデル化されたカルシウム信号と、トランスフォーマーの注意信号の上昇・下降がほぼ同じであることがわかりました。また、ビジョン・トランスフォーマーを使った関連実験でも同様の結果を得ることができました。このことから、彼らの生物学的な神経細胞・星状膠細胞モデルが、トランスフォーマーと同様の方法でデータを処理できる可能性があることが確認されました。

Kozachkovは言います。「星状膠細胞は、視床下部から視覚皮質まで、脳のほとんどあらゆる場所に存在しています」「トランスフォーマーは、テキスト、画像、音声など、あらゆるタイプのデータを処理するのに長けているため、AIではほぼ何にでも使われるようになってきています。この2種類のネットワークが似たような計算をするのは理にかなっていると言えます」

この記事は英語版IBM Researchブログ「AI transformers shed light on the brain’s mysterious astrocytes」(2023年8月31日公開)を翻訳し一部更新したものです。

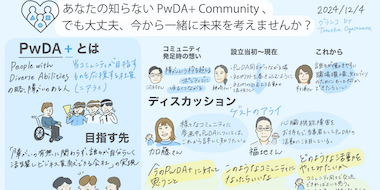

ラウンドテーブルを通じてPwDA+Week2024を振り返る(後編) | インサイド・PwDA+9

IBM Partner Ecosystem

日本IBMグループのダイバーシティー&インクルージョン(D&I)活動の特徴の1つに、当事者ならびにその支援者であるアライが、自発的なコミュニティーを推進していることが挙げられます。 そしてD&Iフ ...続きを読む

ラウンドテーブルを通じてPwDA+Week2024を振り返る(前編) | インサイド・PwDA+9

IBM Partner Ecosystem

日本IBMグループのダイバーシティー&インクルージョン(D&I)活動の特徴の1つに、当事者ならびにその支援者であるアライが、自発的なコミュニティーを推進していることが挙げられます。 そしてD&Iフ ...続きを読む

風は西から——地域から日本を元気に。(「ビジア小倉」グランドオープン・レポート)

IBM Consulting, IBM Partner Ecosystem

福岡県北九州市のJR小倉駅から徒歩7分、100年の歴史を刻む日本でも有数の人気商店街「旦過市場」からもすぐという好立地にグランドオープンしたBIZIA KOKURA(ビジア小倉)。 そのグランドオープン式典が2024年1 ...続きを読む